Art Critique accueille un deuxième dossier thématique constitué par des chercheurs. Intitulé « Visage(s) à contrainte(s) : le portrait à l’ère électro-numérique », ce dossier coordonné par Vincent Ciciliato (artiste et Maître de conférences en Arts numériques à l’Université Jean Monnet de Saint-Étienne) a pour but de confronter la représentation du visage (et plus particulièrement le genre classique du portrait) à sa médiatisation technique. La période choisie – des années 1960 à aujourd’hui – tend à circonscrire un cadre historique dans lequel les technologies électroniques et électro-numériques semblent s’imposer massivement dans les modalités de construction et de réception des œuvres. Cette imposition technologique nous fait donc avancer l’idée de « visages à contraintes », au travers de laquelle se tisse ce lien d’interdépendance (« contrainte », de constringere : « lier ensemble, enchaîner, contenir »), de réciprocité immédiate, entre opération technologique et émergence de nouvelles visagéités. Aujourd’hui publions une contribution de Philippe Boisnard.

D’une question de l’être

Le visage de la cybernétique est à lire dans le double sens du génitif : à la fois le visage compris par la cybernétique, le visage composé ou décomposé au prisme de ce qu’est devenue la cybernétique (par exemple, des technologies de reconnaissance faciale) ; et, à partir de cette observation, la question de la représentation que nous pouvons avoir de la cybernétique, son propre visage (question posée aujourd’hui par les nouveaux développements de l’Intelligence artificielle), permettant de saisir en quel sens elle opère par rapport au visage humain, et ce qu’elle détermine du point de vue de l’identité et par conséquent de l’ipséité[1] du sujet humain, de son être.

Le terme de cybernétique tel que je vais l’entendre, s’il est à comprendre à partir de l’analyse heideggerienne et dans l’horizon de sa critique de Wiener[2], sera replacé dans le cadre historique des avancées liées aux Intelligences Artificielles (IA)[3]. Les avancées de l’IA, notamment depuis 2012-2014, avec le retour de la logique connexionniste, constituent l’un des traits caractéristiques et majeurs de l’évolution de la cybernétique[4]. Heidegger pense que la cybernétique est le dépassement de la métaphysique. Étrange énoncé d’emblée. Pour saisir cet énoncé, il nous faut comprendre d’une part ce qu’est le projet de la métaphysique occidentale et comment Heidegger le saisit, et d’autre part son articulation avec l’essence de la technique.

Le projet de la métaphysique est de saisir l’être du sujet humain à travers une ontologie générale, qui a été dominée aussi bien par l’onto-théologie que par une ontologie rationaliste. Ce projet, comme il se dévoile dans l’histoire de la philosophie par le « connais-toi toi-même », doit permettre de saisir une vérité du sujet, sa constitution, sa structure, et ceci sans reste.

Or Heidegger montre, dès les années 1920, qu’il y a une forme d’impensé dans la métaphysique : au lieu de poser la question de l’être, ce que la métaphysique essaie de saisir c’est la question de l’étant du sujet, à savoir sa substantialisation. Les sciences humaines se sont concentrées sur les déterminations matérielles et relationnelles du sujet, en les posant de plus en plus d’un point de vue logico-mathématique et ces déterminations se sont substituées à la question de la philosophie à partir surtout du XIXe siècle avec la naissance des sciences anthropologiques (psychologie, psychanalyse, sociologie, biologie, puis psychologie sociale …).

Peu à peu, une représentation technicienne de l’homme est apparue et s’est imposée. Invisiblement, l’impensé technique a hanté cette entreprise de compréhension de l’homme. C’est pourquoi Heidegger, dès Être et Temps[5] (1927), pose la question de la technique au cœur de la compréhension de l’être de l’homme, à travers un double niveau d’analyse : l’objectivation de l’homme, et l’analyse de sa manipulation. De là, il questionne l’achèvement de la métaphysique comme à la fois sa résolution et son dépassement révélant : « L’achèvement de la métaphysique commence avec la métaphysique hégélienne du savoir absolu entendu comme esprit de la volonté[6] ». L’esprit de la volonté se définit du point de vue de l’essence de la technique (l’arraisonnement) en tant que « ici la technique (est à prendre) en un sens si essentiel qu’il équivaut à celui de la métaphysique achevée[7] ».

De plus Heidegger montre que la notion de calcul des étants, propre à l’essence de la technique, la mise en stock, la mise en dispositif (Gestell), se dévoile dans la science moderne de la cybernétique. La connaissance de l’homme ainsi se constitue dans les sciences cybernétiques qui reposent sur la compréhension matérielle, logico-mathématique de l’homme selon des rapports de causalités permettant de penser l’homme selon des trajectoires guidées, comme s’il n’était plus qu’un étant parmi tant d’autres. Cette représentation de la cybernétique est définie parfaitement par David Aurel dans La cybernétique et l’humain[8] (1965). David Aurel indique que la notion de libre arbitre tend à disparaître pour peu à peu être modélisée selon des processus mécanistes. L’homme serait ainsi en totalité un être pensable comme une structure déterminable selon des processus, des fonctionnements que l’on pourrait objectiver et de là guider. « Les rapports de l’homme au monde, et avec eux, la totalité de l’existence sociale de l’homme sont enclos dans le domaine où la science cybernétique exerce sa maîtrise[9] ».

La singularité de l’homme serait ainsi effacée en tant que possible inactualisable selon cette inclusion, n’étant plus qu’une illusion de notre imagination, au profit d’une compréhension objective, cybernétiquement déterminable et calculable. Mais si en effet ce dépassement de la métaphysique est attesté, qu’en est-il alors de la question de notre être notamment comprise à partir du visage, tel que Emmanuel Levinas a pu la définir dans Étique et Infini[10] ? Selon Levinas, l’être de l’homme ne peut être réduit à une connaissance, à un jugement déterminant. Et c’est notre visage qui en dévoile la signature. « On peut dire que le visage n’est pas « vu ». […] C’est en cela que la signification du visage le fait sortir de l’être en tant que corrélatif d’un savoir. Au contraire, la vision est recherche d’une adéquation ; elle est ce qui par excellence absorbe l’être. Mais la relation au visage est d’emblée éthique[11] ». Le visage, ce qui nous ouvre à autrui, est ce qui nous fait rencontrer l’infini de la distance de la liberté qui tout à la fois nous sépare et nous relie par la question éthique. Le visage s’échappe de la saisie du contexte, le visage nous renvoie à l’être d’autrui en-deçà de toute connaissance, c’est son irréductible humanité, l’infinité de sa liberté, qui résonne en nous seulement à partir d’un positionnement éthique.

Alors, si nous sommes à l’époque de la cybernétique achevé, en quel sens celle-ci, à travers ces nouvelles procédures liées aux intelligences artificielles, au deep learning, au Big Data, à la biométrie, en vient-elle à se saisir du visage et à le transformer comme une simple donnée ? Que reste-t-il du visage en tant que signature de l’être, signe de la singularité ? Que reste-t-il de cet infini de la liberté que je rencontre par le visage d’autrui, à l’heure de la saisie du visage, en cette heure de la dévisagéité, commandée par les injonctions de sécurité et de surveillance ?

Le règne biométrique de la saisie du visage

Notre époque est hantée par des mythologies, qu’il faudrait penser comme celles qu’a rédigées Roland Barthes entre 1954 et 1956. « Chaque objet du monde peut passer d’une existence fermée, muette, à un état oral, ouvert à l’appropriation de la société[12] ». Les mythes, selon Roland Barthes, ne sont pas des signifiants hors espace, hors temps, mais ils se déterminent comme des idéologèmes qui ont une consistance et une efficacité sociale, et qui permettent à une classe productrice d’idéologie de déterminer une ossature du réel. Les mythes, s’ils reposent sur des choses, ils intègrent cependant dialectiquement, dans leur institution symbolique et leur diffusion sociopsychologique, des vecteurs d’imaginaire.

Notre représentation du monde et notre compréhension actuelle ne reposent plus sur les mêmes mythes que ceux des années 50, à savoir ce ne sont pas les mêmes énoncés qui structurent notre réalité, l’accélération des technologies a produit un certain nombre de mythes qui, ici, entrent en jeu avec la question que nous posons quant à la saisie du visage. Le règne biométrique obéissant à la croyance en la sécurité et en la tolérance zéro fait partie de ces mythes qui sont véhiculés dans nos sociétés, et qui se réalisent selon une forme d’imaginaire. L’imaginaire de la biométrie, son idéologie consiste en l’injonction de sécurité, et de l’injonction de l’offre commerciale adaptée au sujet.

Pour saisir cette dimension de la biométrie, nous pouvons revenir à l’image qui est intégrée dans le film Minority Report réalisé par Steven Spielberg, en 2002. Nous suivons Tom Cruise, qui, en se mettant en rupture de système, traverse, voire divague dans une société dominée par le contrôle technologique sur l’individu. Spielberg fait en sorte de faire varier dans ce film de très nombreuses technologies. Lorsque Tom Cruise arrive dans un espace commercial, sa pupille est analysée en temps réel, et il est reconnu. Le programme lui envoie alors une forme de recommandation publicitaire. Nous constatons, à partir de cette approche fictionnelle, que l’être humain, s’il est bien évidemment constitué de son visage, ce visage, loin d’être énigme, altérité, sert de fiduciaire, d’ID (identifiant) pour les systèmes de reconnaissance visuelle. Dans la série Black Mirror, créée par Charlie Brooker, plus particulièrement dans le premier épisode de la troisième saison, intitulé « Nosedive », la question de la reconnaissance faciale est poussée un peu plus loin que le simple ciblage commercial. En effet, les personnes, toutes munies de leur smartphone à reconnaissance faciale, non seulement perçoivent en temps réel qui elles rencontrent, mais, de plus, elles peuvent noter, selon la relation qu’elles ont, cette personne selon une logique de recommandation. Tout un chacun ayant peut avoir accès à la note globale. La relation éthique et inter-subjective est subordonnée au résultat de la plateforme de notation. Le jugement ne s’appuie plus sur une expérience de l’altérité, mais sur la construction algorithmique de la notation. On passe de la question de l’être à celle de l’agrégation : je suis, j’existe parce que je suis noté et évalué en temps réel. C’est bien ce qui arrive au personnage principal Lacie Pound, et dont le titre est annonciateur : par une suite d’accidents, elle va peu à peu perdre sa note de recommandation, pour devenir une marginale, et être emprisonnée. Alors que les recommandations étaient la base d’une nétiquette sur internet, comme cela avait été promu au début des années 2000 par les Humains associés[13], le réseau n’est plus cloisonné à l’espace internet, mais déborde sur le réel et le visage de l’homme est l’interface de ce passage. Le visage est à la fois l’ID internet et la réalité empirique de mon existence, ce qui fait que l’on me reconnaît. Toutes les dérives sont alors possibles. Je ne suis pas dans ma présentation, mais dans celle qu’un réseau me donne suivant les informations accumulées et recoupées au sein de celui-ci. Je ne me constitue pas en tant que sujet libre, mais selon les règles et les principes a priori déterminés par un dispositif algorithmique. Avec The Circle de James Ponsoldt (2017), ce qui est apparu avec Black Mirror s’accentue. Une ère aléthéiologique hyperbolique y est décrite : chaque individu pouvant être suivi à chaque instant, chacune de ses actions étant enregistrée. Il n’y a plus de différence entre le réseau et le monde matériel. Il n’y a plus qu’une seule réalité synthétique, où ce sont les critères du numérique qui dialectiquement subordonnent l’existence.

Une mythologie s’est développée à partir des années 90, saisir le visage par un ID. Le visage n’est plus injonction infinie de la liberté, qui déborde toute identification, mais il devient un élément matériel qui est déterminé selon un ensemble d’énoncés et de qualités, accumulés et dont il serait le référent. Nous ne sommes plus un être, renvoyant à une ipséité au sens de Paul Ricoeur dans Soi-même comme un autre[14], mais nous sommes seulement les caractères qui constituent l’idem, la mêmeté définissable et reconnaissable. Notre quiddité, pour reprendre Russel, est une somme de prédicats. Et ces prédicats sont constitués en bases de données accessibles pour les autres ou bien pour des institutions politiques ou économiques.

Ce qui est mythologique, ou encore anticipation, n’est pas purement imaginaire, mais est de l’ordre de la constitution historique de nos sociétés. L’idéologie qui prédomine dans tous ces récits est celle de la réduction de l’homme à un élément matériel que l’on peut réduire à un ensemble de fonctions qui permettent de le surveiller ou encore de l’anticiper quant à son existence et ses désirs. L’idéologie est celle du contrôle. Le panopticum, modèle de la prison où tout prisonnier est observable à tout moment, s’est généralisé et dématérialisé à l’ère de la cybernétique. De l’œil centralisé, nous en sommes passés à l’œil éparpillé. Le modèle est ici davantage orwellien quant à la surveillance, mais il ne repose plus sur un pouvoir central, mais le pouvoir est disséminé dans l’ensemble des institutions économiques et politiques de gouvernance. Ainsi depuis la fin de 2017, à Pékin, dans les gares, les policiers ont des lunettes qui permettent la reconnaissance faciale. Cette technologie développée par LLVision, basée à Pékin, permet selon le Wall Street Journal de faire correspondre toute personne ciblée par le regard à une base de données de 10 000 suspects en 100 millisecondes. Ce système portable ne fait que poursuivre ce que l’Allemagne, par exemple, a déployé durant l’été 2017 dans les aéroports. Les caméras sont reliées à un système de reconnaissance faciale automatisée.

Émotions, visage et IA

L’idéologème qui est derrière cette recherche de reconnaissance de l’individu se définit dans le fait que l’homme n’est pas un individu déterminé comme singularité, mais qu’il est à chaque instant l’expression d’éléments qui traduisent des catégories objectives de saisie. Nous pouvons comprendre ici que la caractérologie anthropologique recherchée par la philosophie, que l’on perçoit parfaitement dès le stoïcisme par exemple, en passant par le Traité des passions (1649) de Descartes, ou bien encore par l’analyse caractérielle de Kant, trouve son aboutissement avec le règne biométrique. Le visage de l’homme est l’ensemble des indices qui renvoient à une compréhension objective de son être. De ce fait il est mécaniquement déterminé quant à son expressivité.

L’intuition de la physiognomonie du XVIIIe et du XIXe siècle trouve alors sa réalisation à l’ère des IA et du Big Data. Tel que l’énonçait Johann Kaspar Lavater :

« La physionomie humaine est pour moi, dans l’acception la plus large du mot, l’extérieur, la surface de l’homme en repos ou en mouvement, soit qu’on l’observe lui-même, soit qu’on n’ait devant les yeux que son image. La physiognomonie est la science, la connaissance du rapport qui lie l’extérieur à l’intérieur, la surface visible à ce qu’elle couvre d’invisible. Dans une acception étroite, on entend par physionomie l’air, les traits du visage, et par physiognomonie la connaissance des traits du visage et de leur signification[15] ».

Si on considère ce qu’a fait Microsoft avec l’emotional recognition et les frameworks de reconnaissance faciale, nous nous trouvons, malgré la différence technologique et épistémologique, dans une même procédure. La physiognomonie reposait sur une observation, et une discrimination, reliant des analyses physiologiques et morphopsychologiques en relation avec des actions humaines.

La reconnaissance faciale, telle qu’elle a été appréhendée par les réseaux de neurones et l’ensemble des principes de réductions graphiques liées aux convolutions qui s’effectuent dans le deep neural network, repose sur une logique similaire, mais dont les opérations de comparaison, de regroupement vont être faites peu à peu par l’IA.

L’emotional recognition permet d’abstraire des parties d’une image, de pouvoir les analyser et de les comparer à des sous-ensembles de vecteurs qui ont été constitués selon des principes de Big Data permettant d’indexer ces éléments dans des espaces latents à ndimensions. Par la collection de visages et leur réduction/indexation selon des traits de caractère, les nouveaux visages vont être, à partir de similitudes, eux-mêmes analysés et caractérisés. Si la comparaison était faite dans la physiognomonie par l’intelligence humaine et sa capacité de recoupements et d’accumulation, l’automatisation par l’IA et par l’accumulation des images en base de données a amplifié absolument cette possibilité et dépassé selon deux critères le travail d’observation et de recoupement humain : 1. la base de données constituée et traitée est beaucoup plus importante ; 2. le traitement se fait beaucoup plus rapidement. Cette possibilité d’accumulation des visages étant liée elle-même à un idéologème spécifique, que j’ai analysé dans mon livre Frontières du visage (analogique et numérique)[16], reposant sur la question de la reconnaissance de soi et la visibilité dans la société post-capitaliste de l’information, conduisant tout individu à participer activement à cette constitution des bases de données selon le désir d’être vu dans les réseaux.

Ce processus mène à une forme d’inversion : alors que l’outil est une médiation à partir de laquelle s’effectuaient nos jugements, ou nos intentions, nous devenons progressivement les observateurs d’une finalité de jugement que nous avons déléguée aux IA. La pensée humaine, qui revendiquait d’être l’étape cruciale, devient médiante, face à une externalisation du jugement. C’est l’intelligence artificielle qui in fine juge des traits caractérologiques du visage. Qui envisage ce qui lui fait face.

L’apprentissage des IA étant lui-même progressivement délégué aux IA elles-mêmes. Non seulement, les IA réussissent à déterminer et caractériser, mais de plus elles peuvent, depuis leurs dernières améliorations, parvenir à une possibilité de reconnaissance des visages par processus d’imagination artificielle. La donnée qui est donnée à imaginer, au sens strict, est une image très pixélisée (matrice de 9 carrés colorés). Le projet Google Brain (février 2017) permet d’imaginer quel est le visage qui a été ainsi matricé. Deux réseaux de neurone sont utilisés. Le premier permet de comparer l’image avec des images similaires et ceci par analyse de détails (vecteurs), et donc de trouver la ressemblance. Le second permet de préciser et de créer les détails. Ce qui n’était que de l’ordre de la fiction devient réel. Il y a un processus imaginatif de la machine, que nous observons[17].

Nous avons transposé dans les IA ce qui semblait phénoménologiquement nous déterminer. En effet, le fait de reconnaître l’expressivité du visage de l’Autre repose, selon Husserl[18] sur : 1. un principe de remplissement (Einfühlung) pour le cogito ; 2. un processus de variation eidétique (des images), permettant alors de saisir ce qui se passe chez autrui. C’est en quelque sorte cela que nous faisons opérer aux IA. Si, dans sa pièce Let’s Enhance de 2009[19], Duncan Robson montrait, à partir d’extraits de film, en quel sens la résolution par zoom d’enquêtes policières dans les films hollywoodiens était un fake, presque quinze ans plus tard, il est évident que cela n’est plus du tout fictionnel, mais bien réel[20].

Nous entraînons les IA à faire des efforts de mémoire à partir de la mémorisation qui s’effectue en base de données. Les opérations qui ont lieu sont celles de comparaisons, de croisements, d’affinage, de création d’espaces latents qui vectorialisent le réel du visage, et constituent des virtualités statistiques. Par comparaison de matrices de pixels, on peut reconstituer le visage des individus. De même, au niveau de la reconstitution des visages, une équipe indienne et britannique a mis au point un algorithme de reconnaissance du visage même voilé : Disguised Face Identification (2017)[21]. La perception de l’IA va ainsi plus loin que celle de l’homme. On l’a dotée d’une imagination artificielle qui lui permet d’imaginer des possibilités pertinentes par rapport au réel. C’est parce que nous donnons aux IA ces possibilités que la question du visage se réduit de plus en plus à sa seule matérialité observable et réductible algorithmiquement.

Nous faisons face à une heuristique de l’imagination de l’IA ; Trevor Paglen, avec Faces of ImageNet (2022)[22], montre avec pertinence cette logique. Le spectateur est capté par une caméra, et en temps réel, en lien avec le modèle ImageNet, il est représenté, décrit et mis en relation avec les images concordantes. Le visage est alors saisi par l’induction statistique, et l’individu est défini selon les étiquettes du modèle suivi par l’IA.

Cette volonté de saisie du visage semble inquiéter un certain nombre d’artistes. Marnix de Nijs, avec sa pièce Physiognomonic Scrutinizer (2008-2009)[23], propose aux spectateurs de passer un portique d’aéroport doté d’un système d’analyse biométrique de visages. Nous sommes alors reconnus par confrontation à une base de données produite par l’artiste lui-même (composée de portraits de stars controversées, de criminels et autres personnages marginaux). Nous y voyons notre identité confrontée à celles déjà archivées dans le réseau. Si le processus de ressemblance est au premier abord amusant, au sens où nous sommes reliés – par similitudes physionomiques – au visage d’une autre personne publique, ce qui réside réellement tout au fond de cette œuvre est une forme d’inquiétude générée, d’une part, par la réduction de notre être selon un principe de surveillance, de l’autre, par la possibilité d’erreur. L’œuvre dévoile, par conséquent, que chaque passage, chaque trajet n’est plus de l’ordre de l’anonymat. Le nomadisme, l’errance n’est plus possible, mais selon un ordre de surveillance technique, et une interconnexion des différents dispositifs, tout humain pourrait être à tout moment observé. Loi de la tolérance zéro : il n’y aurait plus d’espace de disparition. L’espace réel étant dupliqué virtuellement selon une cartographie observée et observable sans reste. Rafael Lozano-Hemmer avec Level of confidence (2015)[24] nous montre également en quel sens la disparition semble impossible. Prenant l’enlèvement et la disparition de 43 étudiants de l’école normale de Ayotzinapa, à Iguala (Mexique), le dispositif analyse chaque visiteur afin d’y reconnaître l’un des disparus. Chaque visage va être analysé et comparé aux victimes.

L’humanité de notre visage est affectée par cette logique de l’identification, en étant entièrement réduit à des catégories reposant sur les caractéristiques d’un ID. Tel que l’énonce Gérard Dubey : « La biométrie aujourd’hui se définit en effet comme la possibilité d’identifier sur la base de critères purement techniques un individu dans une masse et dans des flux. Elle consiste à calibrer numériquement certaines parties du corps (empreintes digitales, contour de la main, réseau veineux, fragment d’épiderme, iris) et à mettre en concordance automatique ces données par le biais de systèmes d’information et de communication. Elle est indissociable du processus d’informatisation de la société et de l’impératif de traçabilité (des signes, des choses et aujourd’hui des êtres vivants) qu’impose le recouvrement du monde réel par son image numérique contrôlée et contrôlable[25] ».

Résistance

Il ne s’agit pas de prendre parti, et de rejeter frontalement le déploiement de plus en plus important de la reconnaissance faciale et des logiques de biométrie. J’ai essayé tout au long de ce qui précède de comprendre, à partir d’une nouvelle mythologie, en quel sens, l’intuition d’Heidegger était pertinente, à savoir que l’achèvement de la métaphysique se faisait à l’ère de la technique et de la cybernétique. Il s’agit donc de réfléchir aux dispositifs qui questionnent, critiquent, mettent en défaut les logiques d’absorption cybernétiques. C’est par exemple ce que fait Hito Steyerl dans How Not to Be Seen : A Fucking Didactic Educational .MOV File[26] (2013) révélant, d’une manière humoristique, les logiques de captations, de surveillance par les nouvelles technologies. En mettant en évidence, dans ce qui suit, des résistances, il ne s’agit pas de penser qu’elles sont nouvelles. Bien au contraire, elles sontantérieures à cette émergence des IA, voire même à l’avènement de l’ère numérique. C’est en ce sens que la réduction de l’homme, de son ipséité, à des fonctions était mis en critique par Ricoeur. Ou encore comme Ionesco pouvait l’énoncer : « maintenant ce qui est ennuyeux dans la société c’est que (…) la personne est tentée de s’identifier totalement avec la fonction ; ce n’est pas la fonction qui prend un visage, c’est un homme qui perd son visage qui se déshumanise[27] ».

Face aux mythologies du contrôle, il y a des logiques d’antisystème qui se développent. Ces résistances reposent elles-mêmes sur des idéologèmes précis. Comme cela apparaît, de manière originale, avec Philip K. Dick et son roman A Scanner Darkly (Substance Mort), de 1977. Ici, Bob Arctor, le double du policier Fred, utilise un scramble suit, costume de camouflage qui modifie sans cesse son apparence et donc celle de celui qui le porte. Cela lui permet de ne pas être reconnu par les caméras et les observateurs. Ainsi Philip K. Dick introduit, dès 1977, une mise en critique paranoïaque de la surveillance et invente une tactique d’effacement reposant, de manière paradoxale, sur la génération continue – et extrêmement rapide – d’une infinité d’identités sur la surface du costume de camouflage, permettant de brouiller les algorithmes de reconnaissance faciale.

Face à la substitution du visage par sa reformulation numérique, semble se constituer une forme de stratégie de préservation. Cette stratégie est d’abord en œuvre dans une dialectique du recouvrement/retrait que l’on peut apercevoir à travers plusieurs usages technologiques. Adam Harvey a développé plusieurs angles d’approche pour contrer les surveillances liées à la biométrie. Avec Stealth Wear « Anti-drone » Fashion (2013), l’artiste met en place un ensemble de vêtements, capuches, cagoules, inspiré des vêtements de l’islam. Leurs caractéristiques permettent de bloquer l’analyse thermique du corps. Il crée une frontière entre l’observation thermique du drone, d’une part, et, de l’autre, le visage. Il poursuit ainsi la logique de résistance qu’il avait initiée avec CV Dazzle (2010) qui permet, par un maquillage conçu en rapport aux algorithmes de reconnaissance faciale, de brouiller celle-ci et ainsi de préserver le visage de sa captation. C’est une même voie qu’a poursuivie Grigory Bakunov, en Russie, face au développement de plus en plus important des caméras de surveillance, à Moscou.

Ces stratégies fonctionnent selon un brouillage de ce que serait le caractère de la mêmeté. Elles opèrent une césure à partir de la dimension matérielle entre une ipséité, qui serait « le visage », et les caractères de reconnaissance, que nous avons identifiés avec Ricoeur comme ceux de l’idem. Bien évidemment, le développement algorithmique sera, et est déjà, engagé pour contrer ce type de stratégies de résistance. Toutefois, il apparaît que la notion de visage renvoie bien à la question de la singularité et de sa préservation. Que cela soit avec le suit scramble de K. Dick, ou avec les stratégies de maquillage de Adam Harvey, ce n’est pas le visage d’abord et avant tout que l’on tente de préserver, mais bien la singularité d’être du sujet : sa liberté. Ces exemples montrent la dialectique qui se construit autour du visage.

Ce n’est pas un hasard si le symbole des Anonymous, collectif protéiforme sans réel noyau, se réfère au masque blanc de V pour vendetta, bande dessinée, publiée de 1982 à 1990, scénarisée par Alan Moore et illustrée par David Lloyd. Cette œuvre raconte comment, après l’instauration d’un pouvoir totalitaire en Angleterre, au cours des années 1980, et suite à une guerre mondiale, un anarchiste, qui se fait appeler V, va agir contre ce pouvoir se cachant sous le masque de Guy Fawkes, qui fut le membre le plus actif de la conspiration des poudres au XVIe siècle en Angleterre. Contre la logique de contrôle, les Anonymous ont repris la représentation de ce visage, donnée au cinéma en 2006 par James Mc Teigue. Utiliser un masque n’est pas construire un nouveau visage, mais c’est préserver son propre visage. L’Anonymous ne résulte pas d’un effacement, mais d’une conservation, d’une préservation. Cette logique de préservation face à la constitution des données, qui passe par la mise en retrait de son propre visage, est également expérimentée, selon une autre logique, par l’artiste et philosophe Emmanuel Guez. Fort du constat que la publication d’un visage sur internet est celle d’un ID déterminé, il s’est fait littéralement disparaître, en faisant effacer toutes les photographies le représentant et en interdisant toute photographie de son visage. Dans cette logique, il a même ouvert un compte Facebook où nul portrait, nulle information n’est donnée.

En effet, le visage, en tant qu’identifiant permettant d’agréger un ensemble de prédicats, est au cœur de la constitution en réseau de l’identité matérielle et existentielle du sujet. En 2016, grâce à l’application FindFace[28], un ensemble d’internautes russes présents sur le réseau Dvach[29] ont conçu une nouvelle chasse aux sorcières. En prenant des captures d’écran des actrices de films pornographiques russes, ils ont mis leurs visages dans l’application Findface, et ont retrouvé dans le site Vkontact[30], puis dans d’autres sites internet, l’identité des femmes qui jouaient dans ces films. Egor Tsvetkov, face à cette dérive, a créé une œuvre mettant en avant la porosité entre, d’une part, la présence immédiate du sujet dans sa vie réelle et, de l’autre, la manière avec laquelle son visage renvoie à un ID immédiatement utilisable pour retrouver son identité, accumulée dans les réseaux sociaux. Pendant six semaines, il a pris des photographies d’inconnus dans la rue, le métro ou d’autres lieux publics. En utilisant FindFace, il a retrouvé leurs identités numériques et les a mises en confrontation avec des photographies publiées sur leurs comptes internet.

Une éthique du visage à l’ère des réseaux sociaux

Rejeter catégoriquement la dimension numérique de notre constitution peut sembler un vœu pieu. Il ne s’agit pas ici de cela, sachant que le développement exponentiel des technologies de surveillance du monde dans lequel nous vivons va envelopper chaque réalité humaine progressivement. Il s’agit davantage de réfléchir à une éthique, et spécifiquement à une éthique du visage au cœur des réseaux. Pour comprendre cette possibilité, nous allons tenter de saisir quelques enjeux proposés par trois œuvres digitales.

En 1995, Maurice Benayoun développait l’œuvre le Tunnel sous l’Atlantique. Le dispositif était composé de deux installations interactives situées, dans cette première version, l’une à Paris, au Centre Georges Pompidou, l’autre au Musée d’art contemporain de Montréal[31]. Les participants font face à un tunnel : ils doivent creuser virtuellement des galeries. La matière est constituée d’images et de références artistiques en lien avec les rapports politiques et culturels entre les deux pays. La finalité était de l’ordre de la rencontre virtuelle des deux participants distants dans l’espace. Son enjeu reposait sur le contraste entre : d’une part, les données historiques rencontrées lors de la navigation ; de l’autre, la présence effective des utilisateurs. Celle-ci était à la fois virtuelle et en temps réel. Métaphore de notre activité sur internet : le visage surgissant d’autrui transcende d’un coup les éléments de l’univers du tunnel. Percevant l’autre dans ce tunnel, je me révèle aussi à moi-même en tant qu’existant. Sa présence surgissant fait apparaître ma propre présence de sujet. Le visage de l’autre n’est pas réduit à une donnée, mais il se détache des données accumulées comme matière du tunnel : il surgit comme un être libre, hétérogène aux informations rencontrées. La différence ontologique est marquée par la surprise.

Kyle McDonald avec Sharing Faces (2013)[32] nous offre une expérience de même nature mais qui pose de manière plus visible la question éthique. Ce projet initialement a été conçu entre le Japon et la Corée. Le dispositif est constitué de deux écrans, l’un en Corée, l’autre au Japon. Partant du constat de la tension entre Coréens et Japonais, Kyle McDonald amène les participants à se voir dans les écrans comme des miroirs. Mais leur reflet est constitué des photos prises dans l’autre territoire. Par une analyse posturologique, chaque position qu’un participant prend actualise une photo d’une même posture prise dans l’autre pays. Nous ne pouvons nous voir qu’à travers autrui. Nous ne nous saisissons ainsi qu’à travers l’alter-ego, cet autre-moi qui n’est pas moi. Autrui n’est pas réduit à un ID, mais il est la médiation nécessaire à moi-même. Sa distance révèle ma présence, et je ne peux me percevoir que dans l’altérité de celui qui est ce prochain.

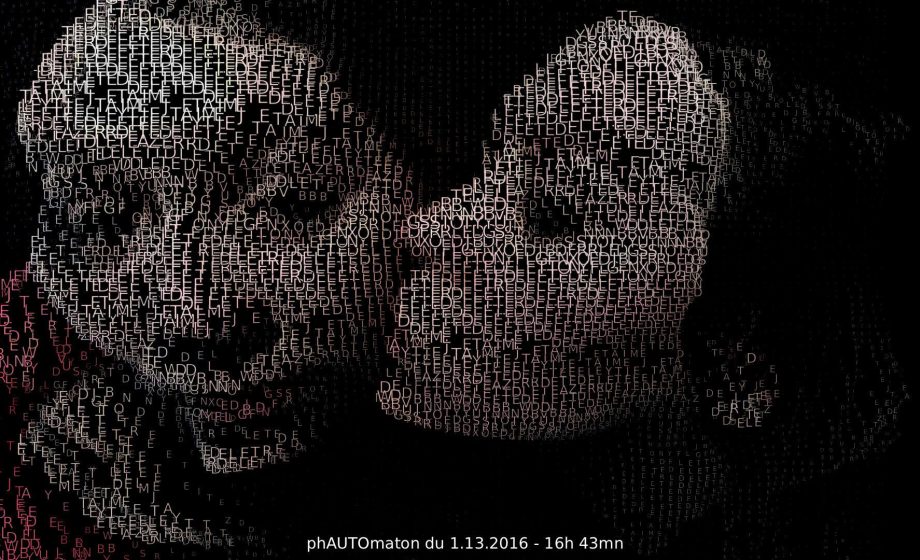

J’aimerais finir par une réflexion éthique à partir de l’œuvre phAUTOmaton que j’ai développée entre 2012 et 2019. Cette œuvre est interactive et participative, elle repose originellement sur la métaphore commune : cela se lit sur le visage. Chaque participant est invité à écrire un texte, qui va constituer son visage en lettres. La photographie réalisée est envoyée immédiatement sur un site internet, où elle rejoint les dizaines de milliers de phAUTOmatons qui ont été déjà pris (plus de 20 000). Cette œuvre pose à la fois une critique de l’espace social et des réseaux sociaux internet. En effet, partant du constat de la répartition des populations dans l’espace réel, l’œuvre phAUTOmaton reposant sur plusieurs cabines posées à des endroits hétérogènes socialement, et dans différents territoires, permet de rassembler sur internet des visages qui ne se rencontrent pas. Ce qui fait visage et appartenance à cette communauté des visages n’est plus de l’ordre de l’inscription économique, ou culturelle, mais de l’ordre ontologique de l’inconditionnalité humaine au sens d’Agamben : le visage et le langage. De plus, sur internet : les visages sont anonymes, ils ne sont pas classés selon un ordre temporel ou spatial, mais mélangés. Ceci obligeant toute personne qui veut retrouver son phAUTOmaton à regarder chaque portrait pour se retrouver. « Le visage et le discours sont liés. Le visage parle. Il parle en ceci que c’est lui qui rend possible et commence tout discours[33] ».

[1] En phénoménologie, le terme désigne l’ « identité propre » du sujet, ce qui fait l’unicité d’une personne.

[2] Le concepteur du sens contemporain du mot cybernétique est Norbert Wiener en 1947. C’est dans son ouvrage de 1948 qu’il précisera les implications de cette conception. Wiener, Norbert, La cybernétique : Information et régulation dans le vivant et la machine, Paris, Seuil, 2014.

[3] Il est indéniable que le domaine de l’IA actuel est tributaire de l’approche cybernétique posée pa WIener en 1956 : « Here I focus on the history of modern artificial intelligence (AI) which is dominated by artificial neural networks (NNs) and deep learning, both conceptually closer to the old field of cybernetics than to what’s been called AI since 1956 (e.g., expert systems and logic programming). » Juergen Schmidhuber, Annotated History of Modern AI and Deep Learning. https://arxiv.org/abs/2212.11279

[4] Il faudrait replacer cette victoire du connexionnisme dans le cadre historique de l’émergence des réseaux de neurones depuis le perceptron de Rosenblatt 1957), forme primitive du réseau de neurones artificiel.

[5] Martin Heidegger, Être et Temps (1927), Paris, Gallimard, 1986.

[6] Cf. Martin Heidegger, op. cit.

[7] Ibid.

[8] David Aurel, La cybernétique et l’humain, Paris, Gallimard, 1965.

[9] Martin Heidegger, « La provenance de l’art et la destination de la pensée » (1967), Cahier Martin Heidegger, Paris, L’Herne, 1983.

[10] Emmanuel Levinas, Éthique et infini. Dialogues avec Philippe Nemo, Paris, Livre de Poche, 1984.

[11] Ibid.

[12] Roland Barthes, Mythologies (1957), Paris, Points essais, 2014, p. 214-213.

[13] www.humains-associes.fr/charte-nethique/

[14] Paul Ricoeur, Soi-même comme un autre, Paris, Seuil, 1990, p. 146-147.

[15] Johann Kaspar Lavater, L’Art de connaître les hommes par la physionomie (1775-1778), Paris, Dapélafoi, 1820.

[16] Boisnard, Philippe, Frontières du visage (analogique et numérique), Paris, L’Harmattan, 2015.

[17] Toute la logique de l’upscaling ou de la complétion de l’image se pose ici avec les IA. L’upscaling d’une image est la possibilité d’augmenter sa résolution. Alors que la résolution tient compte du capteur, l’upscaling repose sur l’invention des pixels manquant. Cette invention ne se fait plus selon seulement la proximité des pixels contigus, mais selon les modèles appris et opérant dans l’IA. Ainsi, l’upscaling repose sur l’imagination d’un réel potentiel par l’IA.

[18] Edmund Husserl, Méditations cartésiennes (1931), Paris, Vrin, 1986.

[19] https://www.youtube.com/watch?app=desktop&&v=Vxq9yj2pVWk

[20] Bin Wu, Wei Wang, Yahui Liu, Zixiang Li, Yao Zhao, DiffusionReward: Enhancing Blind Face Restoration through Reward Feedback Learning, mai 2025, https://arxiv.org/html/2505.17910v1

[21] https://openaccess.thecvf.com/content_ICCV_2017_workshops/papers/w23/Singh_Disguised_Face_Identification_ICCV_2017_paper.pdf

[22] https://www.barcelona.cat/llumbcn/en/installations/2022/faces-imagenet

[23] http://www.marnixdenijs.nl/physiognomic_scrutinizer.htm

[24] https://www.lozano-hemmer.com/level_of_confidence.php

[25] Gérard Dubey, L’identification biométrique : vers un nouveau contrôle social ?, 2008 : https://journals.openedition.org/rsa/352

[26] https://www.artforum.com/video/hito-steyerl-how-not-to-be-seen-a-fucking-didactic-educational-mov-file-2013-165845/

[27] Eugène Ionesco, Entre la vie et le rêve. Entretiens avec Claude Bonnefoy (1977), Paris, Gallimard, p. 18.

[28] Application de reconnaissance faciale pour réseaux sociaux.

[29] Plus grand forum d’images anonyme russe.

[30] Site WEB de réseautage social russe, similaire à Facebook.

[31] https://www.benayoun.com/Tunnel.htm

[32] https://artelectronicmedia.com/en/artwork/sharing-faces-2/

[33] Emmanuel Levinas, op. cit.